Глубокие фейки 2025: как ИИ стирает грань между правдой и ложью (6 фото)

Deepfake-технологии достигли нового уровня, угрожая доверию к информации. Узнайте, как фейки могут повлиять на политику, бизнес и общество — и что мы можем противопоставить этой цифровой угрозе.

Введение.

Искусственный интеллект стремительно меняет не только индустрии и повседневную жизнь, но и то, как мы воспринимаем реальность. Одним из самых тревожных проявлений этой трансформации стали глубокие фейки (deepfakes) — видео и аудио, созданные с помощью нейросетей, способные практически неотличимо подделывать внешность, голос и мимику человека. В 2025 году эта технология вышла на новый уровень, и вместе с этим усилилась угроза глобального недоверия к информации.

Что такое глубокие фейки?

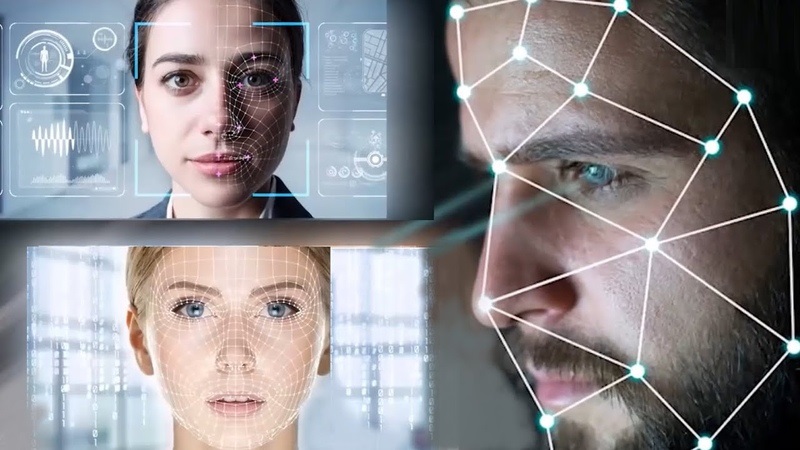

Глубокий фейк — это контент, созданный с использованием алгоритмов машинного обучения, чаще всего нейросетей. Эти технологии анализируют тысячи изображений, аудиофайлов и видео с участием человека, чтобы воссоздать его образ и поведение. Современные deepfake-системы способны генерировать видео, где политик говорит то, чего никогда не говорил, или известный эксперт «поддерживает» фальшивую теорию.

Почему это опасно?

1. Угрозы демократии и политике.

В период выборов или социальных протестов фальшивое видео может изменить мнение миллионов. Уже были случаи, когда видео с подделанным высказыванием политиков использовались для манипуляций общественным мнением. Чем реалистичнее фейк — тем быстрее он распространяется, прежде чем успеют опровергнуть.

2. Репутационные атаки.

Известные личности — от актёров до бизнесменов — становятся жертвами видеофейков, где якобы совершают скандальные поступки. Даже краткосрочное доверие к такому контенту может нанести вред репутации, разрушить карьеры и личную жизнь.

3. Киберпреступность и вымогательство.

Злоумышленники используют deepfake-технологии для имитации голоса руководителей компаний и проведения мошеннических переводов, или создания фальшивых компрометирующих материалов для шантажа.

4. Размывание реальности.

Чем больше в информационном поле ложных видео и аудио, тем меньше общество верит даже в реальные события. Это приводит к "информационному цинизму", где истина и ложь становятся равнозначными.

Как технологии ИИ изменят доверие?

ИИ не только угрожает доверию — он может и защищать его. Уже появляются алгоритмы для автоматического распознавания deepfake-контента, а крупные платформы, такие как YouTube и Meta, внедряют фильтры, обнаруживающие подмену изображения и аудио.

Однако гонка между создателями фейков и разработчиками защитных инструментов продолжается. И в этой гонке ключевым становится цифровое образование пользователей, развитие медиаграмотности и проверка источников.

Что может сделать каждый?

- Скептически относиться к вирусным видео и "сенсациям".

- Проверять информацию через несколько источников.

- Использовать сервисы для анализа метаданных и признаков подделки.

- Развивать цифровую и визуальную грамотность — особенно у детей и подростков.

Заключение.

Глубокие фейки — это не просто новая форма цифровой мистификации. Это вызов нашему восприятию правды. В условиях, когда нейросети могут убедительно подделать любое лицо и голос, будущее доверия к информации зависит от нас. Именно сочетание технологических решений, правового регулирования и критического мышления общества может удержать баланс между свободой и безопасностью.